开源就1500 star!阿里Qwen-Image模型火了!支持中英文字生成、编辑、表现堪称颠覆级!

8 月 5 日,阿里巴巴通义千问团队宣布开源 Qwen-Image

这是通义千问系列中首个图像生成基础模型!

作为一个 200 亿参数的 MMDiT(多模态扩散 Transformer)模型,它在复杂文本渲染和精准图像编辑领域实现了重大突破,尤其在中文场景下的表现堪称 “颠覆级”

复杂文本渲染:让 AI 写出 “真文字”

Qwen-Image 支持多行布局、段落级文本生成,尤其在中文处理上表现突出。

它支持多种语言,包括字母语言(如英语)和表意文字语言(如中文)。

尤其在中文文本生成方面,Qwen-Image 展现了无与伦比的精度,能够生成清晰、格式正确的文本图像,适用于广告设计、宣传海报等场景。

在 LongText-Bench、ChineseWord 等中文专项测试中,其得分较第二名提升超 15%,创下新纪录。即使是英文场景,模型也能为每本书生成风格化封面,书名文字与画面主题高度契合。

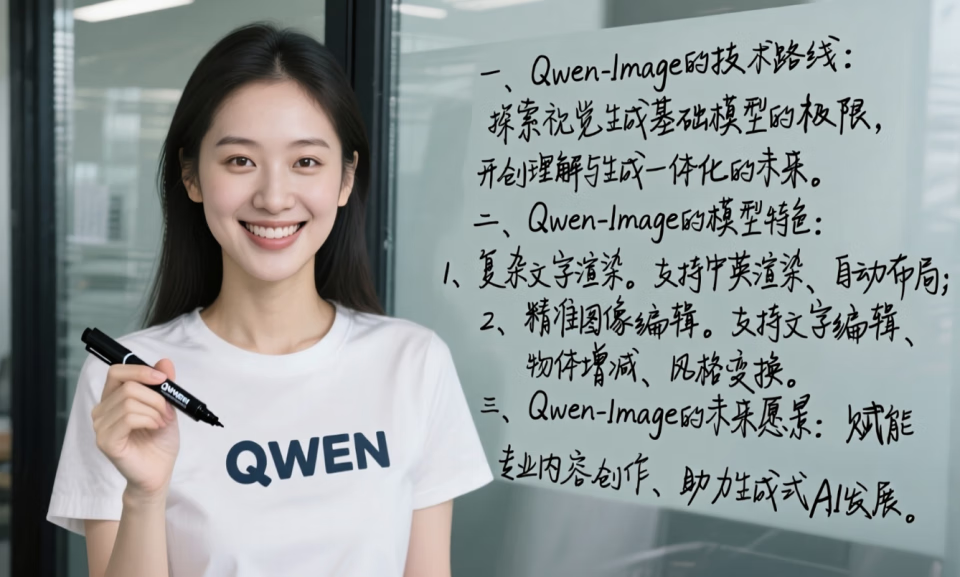

提示词:

一个穿着“QWEN”标志的T恤的中国美女正带着黑色的马克笔面相镜头微笑。她三分之一的玻璃板上手写体写着“一、Qwen-Image的技术路线:探索视觉生成基础模型的极限,预设理解与生成一体化的未来。二、Qwen-Image的模型特色:1、复杂文字渲染。支持中英渲染、自动布局; 2、精准图像编辑。支持文字编辑、工件增减、风格变换。三、Qwen-Image的未来愿景:赋能专业内容创作、助力生成式AI发展。”

效果:

玻璃上的文字生成很自然和准确

再增加一些难度,试一试生成双语

这个就很厉害了,模型能够同时生成中英文两种语言在一个图片中

精准图像编辑:从 “局部修改” 到 “全局一致”

通过增强的多任务训练范式,Qwen-Image 在编辑过程中能保持语义与视觉的一致性。

将皮卡丘改为动漫风格,背景和主题都自然过渡,模型不仅调整光影色调,还会添加动画风格的植被

其支持的操作包括风格迁移、物体增减、姿态调整、文字修改等,非目标区域能保持稳定不变。

多风格生成:从写实到艺术的自由切换

模型支持写实、动漫、赛博朋克、水墨等几十种风格,可灵活控制图像主体、构图、色调。

在 GenEval(通用图像生成)、GEdit(图像编辑)等六大国际基准测试中,Qwen-Image 均获得 SOTA(最佳性能)。

例如,在 TextCraft 基准的中文场景测试项,其 FID 分数较 Stable Diffusion 3 提升 37%,文字可读性达到印刷标准。

如何使用?

如果你只想体验图像生成或简单编辑,无需复杂操作,通过以下渠道即可快速上手:

在线 Demo 直接用

访问官方提供的 Demo 页面(可通过 ModelScope 或 Hugging Face 平台的 Qwen-Image 模型页进入)微信 / 社交平台直达

扫描官方提供的微信二维码加入体验群,或通过 Discord 社区链接进入交流区Qwen Chat 集成工具

在通义千问的聊天界面(chat.qwen.ai)中,切换至 “图像生成” 模式

想本地部署的,可以看以下教程,5分钟搞定

首先确保安装最新版 diffusers 库(用于加载扩散模型),在终端输入:

pip install git+https://github.com/huggingface/diffuserspip install transformers accelerate safetensors

2、加载模型并生成图像

复制以下代码,替换 “你的文字描述” 为具体指令(比如 “生成一张中式茶馆的海报,招牌上写‘清风茶舍’四个毛笔字”),运行后即可在当前目录生成图像文件:

from diffusers import DiffusionPipelineimport torch# 加载模型(首次运行会自动下载,约需占用10GB存储空间)pipeline = DiffusionPipeline.from_pretrained("Qwen/Qwen-Image",torch_dtype=torch.float16).to("cuda") # 若没有NVIDIA显卡,可替换为"cpu"(生成速度会较慢)# 生成图像prompt = "你的文字描述"image = pipeline(prompt).images[0]# 保存图像image.save("qwen_image_result.png")

模型地址:

https://modelscope.cn/models/Qwen/Qwen-Image

代码仓库:

https://github.com/QwenLM/Qwen-Image