实测可灵O1,AI视频界的Banana也来了

而我,也做了一个小片子,来给大家展示一下,它的能力。

https://app.klingai.com/

进入首页之后,你看到这两带颜色且明显长的跟其他的icon不一样画风的,就是可灵O1。

点进去以后,可以看到网址上,写的是Omni。

可灵O1的这个O,就是Omni的缩写,跟GPT-4o的那个o意思一致,这单词来自拉丁语前缀,意思就是“all,所有、一切”。

基本现在大模型圈已经有了一个心照不宣的默契,就是谁在名字里加个 Omni,基本就是在对外说。

我是一个多模态大一统的基座模型。

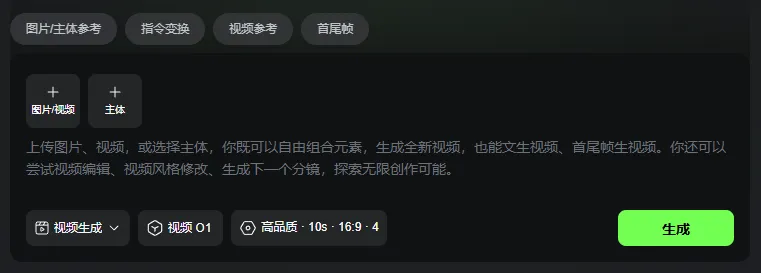

进去以后,就可以看到这么一个界面。

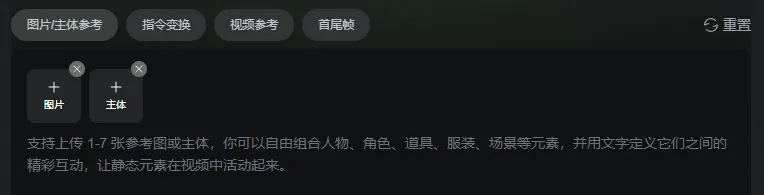

可以上传图片和视频,也可以用主体。

主体不是一个新东西,这个功能你可以理解为一个预设。

把一个人物或者物品的多角度图传上去,然后封装成一个主体,更便于调用。

顶上那一圈功能,是对可灵O1的一个快捷模板,比如参考生视频,就是传几张图,更加确保一致性的情况下,生成视频。

而这次的两个新东西,分别是指令变化和视频参考。

这也是可灵O1这次我觉得的,重中之重。

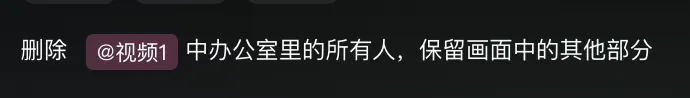

以前的可灵,是完全没有办法,对视频进行编辑或参考的,但是这次,终于可以了,这也是我为什么想说,这是AI视频领域的Nano Banana的原因。

虽然这还是第一版,还有部分局限性,但是这也是第一次,我们用嘴改视频,终于也成为了可能。

我列几个我自己觉得还是比较有趣的玩法。

让大家看看它的能力。

以前要在视频里多加一个东西,比如桌子上多一杯奶茶,天空多一架飞机,街道多一辆车,这种事真的究极费劲。

随便一小段,就能干掉一个后期师一天,真的,特别费人,巨浪费时间。

特别是一些综艺,比如某个艺人塌房的时候,那抠人抠的。。。简直是噩梦。

这次在参数上,有一个比较新的点也可以说下,就是时长自由,3~10s内的视频,都可以自由生成。

比如。

不改人,只改衣服颜色,不改构图,只把夏天改成冬天,一键变雪景,不改镜头运动,只把楼下那条路,变成开裂的地表等等等等。

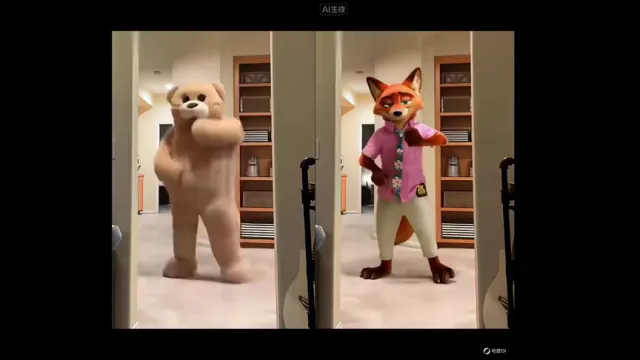

简单说,就是,比如你有一个角色跳舞的视频A,还有一个角色或者插画人物B,用可灵O1,就可以让B按照A的动作,跳一模一样的舞。

比如原跳舞视频是这个。

很魔性很抽象。

现在,我们给他一个疯狂动物城里面的尼克,让他也来跳这个舞。

比如把现实拍摄的视频,改成手绘动画,或者把城市夜景变成赛博朋克等等。

还是用我最开始拍的空地,我们直接把他变成,全部变成像素化,包括手,地面,远处的建筑和天空。

又或者,把我的实拍视频,加上蒙克那张经典的呐喊。

然后,就变成了一个非常具有视觉冲击力的风格。

这个玩法,我特别喜欢。

可灵O1,是AI视频领域,第一个真正意义上的大一统模型。

当然,因为是初期,模型还做不到完美。比如在多主体识别、画面质量的呈现上还能做得更好。

但,这是前往更牛逼的多模态模型的,必经之路。

现在的Nano Banana Pro强到飞起,也是从当年的Nano Banana一代,逐渐进化而来的。

就像2024年6月6号,我们看可灵1.0的时候。

也许几年之后回头看今天,可灵O1只是一个新时代的开始,就像我们用现在的眼光,来看可灵1.0那样。

但如果某一天,我们真的有那种,所谓的给一句话,它就能帮你从策划到拍片到剪辑全包的终极视频 AI。

那它的族谱往上翻,我觉得肯定会写着。

这里,曾经有一个叫可灵O1的名字。

从这一代开始,我们第一次认认真真的。

把用嘴改视频。

当成了一件理所当然的事。

>/ 作者:卡兹克、水杉、Chiyo