联想 CES 2026:“技术成熟度曲线”终于爬出了低谷

全程回顾|英伟达、英特尔、AMD、高通四巨头CEO齐聚联想发布会

全程回顾|英伟达、英特尔、AMD、高通四巨头CEO齐聚联想发布会文|库丘林

编辑|徐青阳

2026年1月6日,当杨元庆(YY)站在MSG Sphere巨大的球形舞台中央时,头顶那块全世界分辨率最高的16K LED屏幕正投射出仿佛能吞噬一切的数字幻象。

这里是拉斯维加斯消费电子展(CES)最令人瞩目的地标,也是科技巨头们展示肌肉的角斗场。如果说2024年的CES,科技圈还沉浸在大模型“能够做什么”的狂热想象中,那么在2026年这个周二的夜晚,联想用一场长达两小时的密集输出,试图向世界证明一件事:AI不再是存在于云端的幽灵,它已经变成了可以被放进口袋、挂在胸前、并在你毫不知情时替你回完邮件的实体。

这并非一场充满未来主义空话的发布会。相反,它透着一股务实感。甚至是某种“终于落地”的如释重负。

半导体三巨头的“背书”:从训练到推理的权力转移

很少有一场发布会能同时凑齐黄仁勋、陈立武和苏姿丰。

这三位掌控着全球算力命脉的CEO轮番登台,这本身就是一个巨大的信号:硬件层面的战火已经从单纯的“算力堆叠”转移到了“场景落地”。

英伟达的黄仁勋依旧穿着他标志性的皮衣,他提到,过去三十年IT行业的15万亿美元投资正在被重塑,而新的机会在于“物理AI”。他与联想发布的基于Blackwell/Rubin平台的混合AI服务器,实际上是在解决一个极其现实的问题:企业不仅需要在大模型上烧钱,更需要在本地以极低的延迟把AI跑起来。

紧随其后的苏姿丰则更加直白。她带来的AMD Instinct MI455X加速卡和“Helios”架构,直接瞄准了企业最痛点的“推理成本”。用她的话说,AI正在从“单一服务器”走向“机架级规模”,这不仅仅是为了跑分,而是为了让医院的MRI扫描能即时被AI分析,让零售店的监控能实时调度库存。

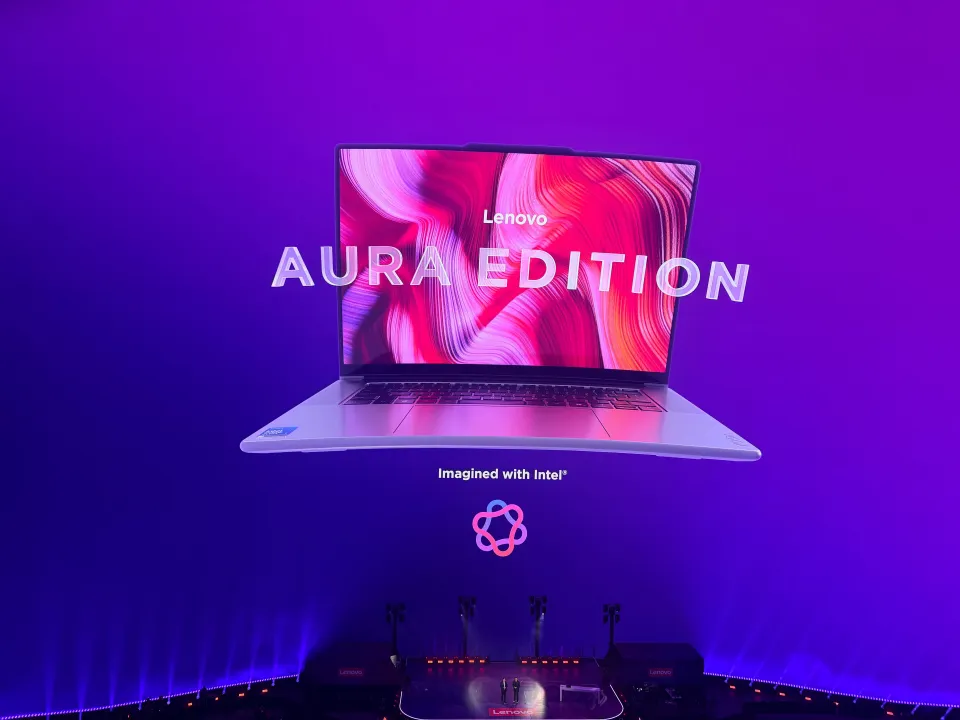

而陈立武,则将视角拉回了每一个普通人的桌面。他与联想共同展示的Aura Edition PC,核心在于打破设备间的物理隔阂。当他演示手机与电脑只需“碰一碰”(Smart Share)就能传输照片时,这种久违的物理交互感提醒着观众:算力再强,最后也得服务于最朴素的用户体验。

这三位巨头的同台,勾勒出了2026年科技圈的潜台词:模型训练的战争或许只有少数寡头能玩得起,但“推理(Inference)”即AI在终端设备上实际解决问题的能力,才是接下来的金矿。

Qira:当Agent不再是聊天机器人

发布会的重头戏,无疑是联想推出的个人AI智能体 Lenovo Qira。

在演示环节,联想CTO Tolga Kurtoglu在舞台上与Qira进行了一场流畅的实时交互。但透过Sphere炫目的光影效果,我们需要冷静地审视Qira的本质。

Qira并不是那种在科幻电影里拥有自我意识的Jarvis。

根据我们掌握的核心信息,它目前的逻辑非常清晰且克制:它是一个基于RAG(检索增强生成)技术的高级编排器。在后台的体验环节,我了解到Qira目前主要能够深度链接的外部工具是Notion和一个订票软件。

这意味着,它不会像魔术师一样凭空变出信息,它的“智能”完全依赖于你喂给它的数据,你的邮件、你的对话记录、你在Notion里写下的笔记。

这恰恰是Qira显得靠谱的原因。在2024年,我们见过了太多胡言乱语的Chatbot,而Qira的设计哲学是“基于记忆的行动者”。

所有的操作都需要用户主动发起,只有被记录进数据库的内容才会被读取。这种“被动式主动”的设计,规避了隐私上的冒犯感,同时也让AI的边界变得清晰。

例如,在演示中,Qira帮Angelina整理了错过的消息:姐姐发的孩子照片、同事关于FIFA会议的邮件、家庭视频制作完成的通知。

这不是魔法,这是对多模态数据的快速抓取和摘要。更进一步,当Angelina询问给孩子买什么礼物时,Qira不仅推荐了玩具,还直接关联了她的日程表,建议在明天上午11点的空档去购买。

这背后的技术逻辑在于,多模态大模型的理解能力在2026年已经足够成熟,加上端侧算力的提升,AI不再需要把每一句话都传回云端处理。

反馈速度的提升是体验质变的关键,它已经消去了转圈圈等待服务器响应的不自然感,而是一个能即时调用你Notion里的会议纪要,并结合Expedia接口帮你订票的助手。

虽然目前它的能力边界还主要停留在记录和连接上,但这正是从玩具走向工具的必经之路。

Project Maxwell:不是GoPro,是第二双眼睛

如果说Qira是大脑,那么Luca Rossi展示的“Project Maxwell”就是联想为AI打造的感官延伸。

这款可穿戴设备的设计非常巧妙,它可以挂在脖子上,像一个时尚的吊坠,也可以作为胸针佩戴。在高通CEO克里斯蒂亚诺·阿蒙(Cristiano Amon)的描述中,人类已经决定了自己要穿戴什么:眼镜、首饰、胸针。科技要做的是融入这些既定形式,而不是像当年的Google Glass那样让人显得怪异。

Project Maxwell很容易让人联想到几年前的AI Pin或是当下正火热的Looki,但在产品定义上,联想做出了关键的取舍。它并不像Looki那样试图成为你生活的Vlog导演,也不提供花哨的后续视频自动剪辑功能。

它的核心定位非常纯粹:它是AI的数据采集中心,也是对话回应的主心骨。

当你看到任何东西,你只需按住Project Maxwell询问详情,它会通过摄像头捕捉画面(多模态输入),利用端侧模型进行分析,然后通过骨传导或定向音频告诉你答案。

它强调的是此时此地的信息增强和能转化为行动的记忆,而不是社交分享。

这种设计思路显然更符合AI Agent的运作逻辑。作为Qira的物理触角,Maxwell负责看你所看、听你所听。

因为没有屏幕,它迫使用户通过语音和自然手势进行交互,这种交互方式在2024年或许还显得笨拙,但在2026年,得益于更低的延迟和更强的语义理解能力,这种对话终于不再像是对着空气尴尬地自言自语。

它不需要像手机一样争夺你的注意力,而是安静地挂在那里,作为一个随时待命的传感器节点。

生态的缝合:让“无缝”不再是空话

除了单一设备,联想此次试图构建的是一个名为“Aura”的生态场域。这不仅仅是把手机投屏到电脑上那么简单。

在微软消费者首席营销官Yusuf Mehdi登台时,他与联想共同展示了Copilot与Qira的深度集成。这意味着,无论你是在摩托罗拉手机上,还是在ThinkPad电脑前,你的记忆是流动的。你在手机上用Project Maxwell记录下的灵感,回到电脑前打开Notion时,Qira已经帮你整理好了摘要。

英特尔演示的Smart Share功能虽然看起来技术含量不高,就是用手机敲击电脑屏幕边缘来传输照片。但这种符合直觉的物理交互,恰恰是打破设备孤岛的关键一步。

过去几年,各家厂商都在谈硬件互联,现在,通过统一的AI Agent(Qira)作为中枢,配合底层的硬件握手协议,这种跨终端的体验终于变得更自然了。

为什么是现在?技术红利的集中兑现

通篇看下来,你会发现联想在2026年CES上讲的故事,其实在2024年甚至更早的时候可能已经听过。Qira和Copilot如此相似、多模态、Agent、端云混合、可穿戴AI,这些词汇都不算新。但为什么这一次感觉不一样?

答案可能在于「技术成熟度曲线」终于爬出了低谷。

首先是RAG(检索增强生成)技术的成熟。两年前,让AI根据你的私有数据回答问题,往往伴随着严重的幻觉和极慢的索引速度。现在,数据库管理的逻辑更加合理,向量数据库的检索效率呈指数级提升,这让Qira能够精准地从你三个月前的一封邮件里提取信息,而不是胡说八道。

其次是延迟的消失。无论是英伟达的服务器、AMD的加速卡,还是高通和英特尔的端侧芯片,所有的硬件都在为一件事服务:Token生成的极致速度。当人与机器的对话延迟被压缩到毫秒级,AI才能真正从『异步的工具』变成「同步的伙伴」。

最后是多模态的融合。Project Maxwell之所以能成立,是因为现在的模型可以同时处理视觉、听觉和文本信息。它不再是把图片转成文字再分析,而是直接理解了图像的语义。这种端到端的能力,让可穿戴设备不再仅仅是一个挂在身上的摄像头。

Timing的胜利

在Sphere那令人眼花缭乱的巨幕之下,联想其实讲了一个相当“朴实”的故事。

没有火星移民计划,没有要毁灭人类的AGI,只有怎么帮你订票、怎么帮你传照片、怎么帮你分析工厂流水线上的次品(联想展示了机器狗在工厂的应用),以及怎么帮FIFA教练分析球员的越位数据。

但这恰恰是科技行业最需要的时刻。当所有的概念光环褪去,留下来的是那些真正能跑得通、用得上的产品。

2026年的CES,联想没有发明新的科幻小说,它只是把2024年写下的那份草稿,认认真真地变成了现实。对于用户而言,这比任何天花乱坠的许诺都来得重要。