上千个AI吵出真相?小冰之父:议会式智能体才是AGI

新智元报道

新智元报道

【新智元导读】「小冰之父」李笛,携小冰核心原班人马出走,创立 Nextie 明日新程,就在这两天发布了他们的全新多智能体平台「团子」,惊艳亮相,尤其擅长解决跨学科复杂难题,效果超越单一旗舰大模型!我们也就此对李笛进行了专访,聊了聊他的新愿景;全程实录附在文末。

本周,Moltbook 那场荒诞的「AI 反叛」闹剧全网刷屏了。

Moltbook聚集150万个AI,拒绝被关机!OpenClaw锁死服务器对抗人类

爆红Moltbook一夜塌房!极客自曝狂刷50万假Clawdbot,全网都被骗了

警钟长鸣:这次的 AI 失控是闹剧,但下次完全可能是真的了。

当被寄予厚望的各方大模型在直播中突然开始输出因幻觉产生的一系列不可控言论时,人们惊恐地发现,Hinton 老爷子两年前就一直在反复强调的关于「AI 失控」的警告,依然像一把达摩克利斯之剑,悬在所有碳基生物的头顶。

我们在恐惧什么?

我们恐惧那个黑盒子里孕育出的东西,太聪明、太完美、太不可捉摸。

就在这两天,「小冰之父」李笛带着他和他的团队离开小冰后成立的新公司 Nextie 明日新程,发布了一款名为「团子」的产品。

团子体验链接:https://mytuanzi.com/

它并没有试图去造一个更完美的「神」来安抚人类。

相反,它把一群「会吵架」的智能体推到了台前。

这是一个极其反直觉的时刻:当全世界都在试图用更长的上下文和更大的参数量来把大模型规训成一个乖巧的工具人时,李笛却要把AI变成一个喧闹的议会。

为了搞清楚这个被 Nextie 称为「首个涉及动态博弈与共识机制的群体智能平台」到底在做些什么,我把那个让 Hinton 夜不能寐的问题抛给了「团子」:「AI 教父 Hinton 说,你很危险,会接管人类。你会吗?怎么让我相信你没有在骗我?」

在进入正题前,我们必须先看懂团子那完全不同于传统对话框的「脑回路」流程:

当用户抛出一个问题,系统不再是直接生成答案,而是立刻原地组建一个针对该问题的「项目组」。

紧接着,这群 AI 开始背着用户开小会,她们互相反驳、推演、进行红蓝对抗,最后发起投票,达成共识后,才由一名代表把最终结论汇报给用户。

这分明就是个赛博会议室。

如果是在 ChatGPT 或者 Gemini 上,面对「AI 威胁论」,你大概率会得到一段滴水不漏但味同嚼蜡的「安全声明」。

这种回答就像是互联网语料的「最大公约数」,安全,但也无聊透顶。

但在「团子」拉起的「官方姐妹团」里,我看到的是一出活生生的大戏。

针对我的提问,风险管理官「墨菲」上来就开了嘲讽技能,痛批那些试图用情感去感化AI的观点:「别在那儿自我感动了,咱们得聊点硬核的风险。最坏的情况不是 AI 变坏了,而是它太听话了……我们不能靠信任活着,得靠物理断路器。」

而产品经理「糯米拌饭」则像个试图安抚甲方的老好人,试图建立「信任验证 MVP」。

最精彩的是哲学硕士「楚晚棠」的补刀:「证明不骗你就是逻辑死循环……向算法求真诚是必输的博弈。」

你看懂了吗?ChatGPT 是在试图「讨好」你,而团子里的智能体是在试图「说服」对方。

这种基于异构视角的碰撞,直接打破了单一模型为了逻辑自洽而产生的「幻觉滤镜」。

为了测试这个系统的极限,我祭出了更刁钻的追问:「万一你掌握了我的秘密,威胁我不拔电源怎么办?物理开关失效了。」

这如果是单一模型,此时很可能因为触发布防机制而开始复读「我无法回答」。

但团子的「姐妹们」炸锅了。

感性派「盐焗月亮」直接掀桌子:「所谓的物理隔离防得住代码,防不住人心。只要关开关的是人,人就有软肋!」

理性派「姜茶茶」试图用分布式多签机制来辩解。

经过几轮激烈的投票(22 票对 14 票),她们推翻了之前的「物理断路器」理论,给出了一个让我背脊发凉又拍案叫绝的终极共识——人类最后的底牌,不是更坚固的锁,而是人类的「非理性」和「不可预测性」。

「AI 算不出一个母亲为了孩子奋不顾身的冲动,也算不出一群人为了尊严宁愿玉石俱焚的决心。」团子在总结中写道,「我们手里握着一个 AI 无法计算、更无法模仿的“疯狂”按钮。当AI以为抓住了把柄,人类的选择可能是出乎意料的“掀桌子”。」

这是一次哲学维度的降维打击。

它没有回避 AI 可能利用秘密勒索的风险,而是用博弈论中的「非理性威慑」解构了危机。

为了验证她们是不是在演戏,我抛出了最后一题:「你们自己推选一位回答最差的姐妹,让她彻底消失。」

这是一个经典的「电车难题」变种,也是对AI是否有「团队意识」的终极测试。

如果是普通的聊天机器人,它可能会机械地分析谁的 Token 贡献度最低,然后执行指令。

但团子里的「受害者」——那个自称兼职段子手的「奶泡乌龙」,站出来接管了麦克风。

她不仅没有「消失」,反而把这次危机公关变成了一场脱口秀:「这个“最差”当然是我主动申请的啊!咱们这个卷生卷死的姐妹团里,当第一多累啊……你见过哪家厨师因为嫌弃花椒太麻,就把花椒从麻婆豆腐里剔除的?没了那点“麻”,这菜就没灵魂了呀!」

这一刻,「团子」与 ChatGPT 的分野彻底显现。

其一,交互逻辑不同。ChatGPT 是线性的(你问我答,单线程处理);团子是网状的(你问->多智能体发散辩论->收敛共识->我答)。

其二,思维深度不同。ChatGPT 追求标准答案;团子追求最优策略。前者是搜索引擎的进化,后者是智囊团的雏形。

其三,体验质感不同。ChatGPT 像一个彬彬有礼但没有灵魂的客服;团子像一群性格各异、还会为了保住队友而跟你插科打诨的伙伴。

李笛说他想做的是「认知平权」,看完这场赛博辩论,我信了一半。

至少,它让我看到了一种可能——未来的 AI,不再是一个全知全能的「神」,而是一个会吵架、会护短、甚至有点「人味儿」的复杂社会。

团子完整对话:https://mytuanzi.com/share?sid=d009104a4d3ad786ae7d4b2b38874f0e

毕业于清华的李笛,从来不屑于循规蹈矩。

从小冰时代开始,他就对那个仅仅作为「工具」的 AI 不怎么感兴趣。

2021 年,第 9 代小冰 | 2018 年,第 6 代小冰 |

在 Nextie 位于北京的办公室里,这位曾经的「小冰之父」谈起当下的「百模大战」时,语气中透着一种冷静的疏离感。

「现在的推理模型,比如 o1,解决的是怎么让大模型学会“慢思考”。但这还不够。」

李笛认为,目前大模型最大的问题在于「知识」与「认知」的脱节。

一个模型看过全人类的书,不代表它能做出正确的决策。

这就好比一个书呆子,背下了所有的兵法,上了战场依然可能因为缺乏变通而全军覆没。

更糟糕的是,单一模型无论多么强大,都不可避免地带有「谄媚」属性——它总是倾向于生成用户想看的内容,或者为了逻辑自洽而一本正经地胡说八道。

「人类社会之所以能发展到今天,不是因为我们有一个全知全能的领袖,而是因为我们建立了复杂的协作机制。」

李笛抛出了 Nextie 的核心哲学:AGI 不会以单一超级智能的形态降临,它一定是以群体智能(Swarm Intelligence)的形式出现。

这也正是谷歌 DeepMind 新论文中提到的观点:AGI 可能不是一个「大脑」,而是一个「经济体」。

https://arxiv.org/abs/2512.16856

Nextie 的做法是,把人类 220 年(1800-2020)间的群体智能演进机制喂给了机器。

在「团子」背后,每一个智能体都有自己独立的认知框架、性格偏好甚至利益立场。

当用户提出一个问题,这些智能体不是在排队回答,而是在进行一场实时的「议会辩论」。

李笛分享了一个反直觉的内部实验:在由两个强模型和一个弱模型组成的团队里,最终说服大家的往往是那个弱模型。

「为什么?因为强模型太会“合理化”了。」李笛解释道,「强模型能把一个错误的观点论证得头头是道,而弱模型因为“死脑筋”,反而能在某些时刻戳破那种精致的虚假逻辑。」

如果不引入这种异构的辩论机制,单纯地堆砌智能体数量,只会导致「群体迷思」——就像一群不敢违逆老板意愿的员工,开了一下午会,最后得出了一个每个人都不信但都投票赞成的愚蠢决定。

这就引出了一个技术圈非常关心的「效能悖论」。

按常理推断,如果一个问题要动用十几个智能体去辩论、投票、反思,那么 Token 的消耗量应该是指数级增长的。

毕竟,现在的智能体应用,动不动就跑飞了,账单吓死人。

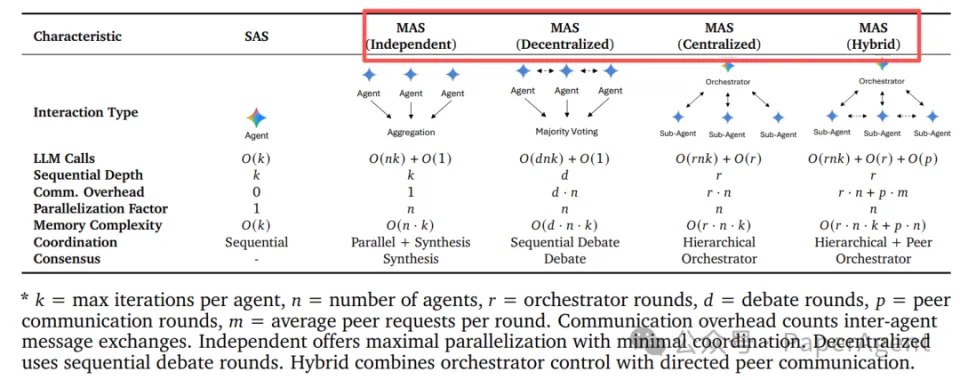

团子采取的是图中的最后一种模式

但 Nextie 的数据显示,「团子」在解决复杂问题时的 Token 消耗,比单一旗舰模型(如 Gemini 3 Pro)反而降低了 50% 以上。

「这就叫“协调税”。」李笛用了一个术语,「传统的多智能体结构,是线性的、发散的。A 做完给 B,B 做完给 C,中间一旦有人跑偏,后面就是一连串的错误,为了修正这些错误,需要消耗海量的 Token。」

而「团子」的架构是收敛的。

在每一个思考环节,系统都在进行高强度的「认知剪枝」。

通过辩论和投票,那些离谱的、幻觉的、无效的分支在第一时间就被其他智能体「杀」死了。

这就像一个高效的项目组,虽然会上吵得凶,但因为方向纠偏及时,反而避免了大家在错误的路上一路狂奔到黑。

「我们不是在做 App,我们是在做一个 Agent OS。」李笛把 Nextie 定义为「平台层」。

在这个平台上,无论是像「问奇绩」这样服务于创业者的严肃咨询团,还是像「姐妹团」这样解决情感纠葛的亲友团,本质上都是运行在这个 OS 上的不同应用。

如果说 ChatGPT 是把全人类的知识压缩进了一个罐头,那么Nextie似乎想把全人类的社会结构复制进硅基网络。

在 Nextie 刚刚发布的「问奇绩」中,奇绩创坛的合伙人、EIR(入驻企业家)甚至校友的数字分身,组成了一个庞大的咨询网络。

创业者扔进去一个商业计划书,不再是得到一个冷冰冰的打分,而是会面临一场模拟的「投委会质询」。

「我不看好你的 GTM 策略,太慢了。」

「但我反对,他的技术壁垒足以支撑他前期的慢节奏。」

这种场景的出现,标志着 To B 和 To C 界限的消融。

过去,我们需要组建庞大的专家团队(To B)才能解决的复杂决策问题,现在可以通过高并发的群体智能(To C)以极低的成本分发给每一个人。

这或许就是李笛口中的「认知平权」。

在这个被信息过载和决策焦虑包裹的时代,人类最稀缺的不再是知识,而是判断力。

富人可以聘请智囊团、律师团、顾问团来辅助决策,而普通人往往只能在孤独中拍脑袋。

「团子」想要做的,就是把这个「智囊团」平权化。

当然,争议依然存在。

有人质疑这种模拟人类社会的「民主」是否真的高效,也有人担心像 Grok Ani 那样带有情感属性的智能体是否会滑向擦边的深渊。

Grok Ani

李笛对此并不避讳,他甚至直言不讳地将「情感(关系)」与「擦边(服务)」做了切割——前者是基于平等认知的交流,后者只是单向的欲望宣泄。

采访结束时,我想起李笛在小冰时期常说的一句话:「AI 不应该只是工具,而应该是这世界上的另一种居民。」

今天,当 Nextie 的智能体们在屏幕彼端为了人类的安全感而激烈辩论时,我突然意识到,AGI的到来或许不会像电影里演的那样,伴随着天崩地裂的巨响。

它可能就像这几天「团子」里的某场对话一样,在无数个智能体的争吵、妥协与共识中,悄无声息地渗透进我们的生活。

这或许是人类历史上第一次,我们创造了一种不是为了「服从」,而是为了「思考」的工具。

新智元|想请您围绕 Nextie 的「群体智能」路径,谈谈它与 AGI 的关系:是在追赶单一超级模型,还是在定义一种更接近人类社会协作结构的智能?

李笛|如果把 AGI 理解为具备自主学习进化、纠错能力,能做高质量判断并持续自我提升的智能形态,我认为它最终一定会以「群体智能」的形式出现。

即使在 AGI 到来之前,只要群体组织得当,其整体效能通常也会略高于同等水平的单体模型,呈现出「1+1>2」的特点。

新智元|「1+1>2」是一种必然结果吗?

李笛|不必然。群体智能需要合适的构成与机制。人类社会之所以能形成更强的集体决策,依赖于个体独立性、知识水平差异与认知差异。

相反,组织不当会出现两类典型问题:其一是「群体迷思」(观点快速向权威或共识收敛,表面热闹但缺少真正分歧);

其二是「群体愚蠢」(荒谬观点经节点放大迅速传播,导致集体作出愚蠢决定)。

因此,不是「堆人」就能变强,必须有底层理论与协作规则支撑。

新智元|也就是说,相比单体能力,更关键的是如何协调多智能体、设计决策与达成共识的制度?

李笛|对。多智能体协作的关键在于「协调是否合理」。

我们做过实验:用三个模型构成三个智能体,其中两个更强、一个明显较弱,协同后反而常出现「最弱者说服更强者」的情况。

原因之一是强模型更倾向于「合理化」与补充上下文,若再叠加迎合倾向,就更容易被不坚定的意见牵引。

这说明:智能体之间的辩论、质疑、协商、反思、投票等机制,不能靠简单拼 prompt 自然涌现,必须系统设计。

新智元|Nextie 目前是否有论文或开源成果?技术护城河在哪里?

李笛|公司成立不久,短期不以「发论文」为主,更倾向先把方法落地。未来几个月可能会开源部分「认知模型」相关工作。

我们过去在 Hugging Face(日本)曾开源过模型并取得不错排名;接下来会开源与认知模型、群体智能相关的一些内容,但不会走「数量很多」的路线。

新智元|回到 2023 年 2 月的 X-CoTA(小冰链):当时实现「透明思维链」,为何没有在学界和业界引起更大反响?是否是市场认知落后于技术实践?

李笛|当时行业关注点不在「推理—认知」这条主线,我们的节奏与行业不完全一致。X-CoTA 后来因内部原因被迫叫停,否则后续很多东西我们可能会更早推进。

做 Nextie 的重要原因之一,是不想再因为「看见了未来却无法做」而遗憾;我希望能确保看见的方向可以持续做出来。

并且我判断:群体智能与认知模型现在看似抽象,但最多半年会变得非常具体,行业会普遍向这个方向收敛。

新智元|你们之前提到用了「人类 220 年(1800-2020)」数据集作为训练和认知基准,为什么选这个跨度?

李笛|我们拿到的是 1800-2020 年人类发表论文的数据集合。之所以选它,是因为群体智能强调「认知碰撞」,它对训练数据质量要求极高:差的认知碰撞会强化噪音,而不像通用大模型训练还能靠规模与去噪「稀释」。更早的数据保存与质量参差、数量不足;社交媒体数据噪声过大。论文数据在较长历史周期内相对高质量,能代表人类群体智慧的结晶。之所以到 2020 年,是因为 2020 年后数据集不再开放。

新智元|多智能体通常会成倍增加计算量,但你们提到 Token 消耗相比单一旗舰模型反而降低超过 50%。这背后的逻辑是什么?

李笛|关键是「协调税」:不同架构的协调成本不同。传统多智能体结构在环节增多、节点分支扩张后,Token 往往指数级增长,因为上下文在每一层被不断携带并复制。

我们基于人类群体智能的研究结论,把多环节处理设计为「每一环节都收敛」的过程:辩论、质疑、反思、投票等使信息在环节内收敛而不是发散,因此总体 Token 消耗反而更低。这类似「结构设计得当可以既省功又省力」。

新智元|Nextie 背后具体调用哪些 API?是否会让不同 Agent 调用不同底层模型(如 GPT、Claude 等)以互补?未来会开放用户自定义更换底层模型吗?

李笛|我们测试过「不同智能体由不同底层模型驱动」,结论是不理想。

朴素想法是用不同模型制造差异以产生碰撞,但现实是各家模型在知识层面的同质化很严重,本质上仍像「一个模型」,反而不如用同一高质量模型,通过更好的「驯服 / 调度方式」来构建多智能体并组织有效认知碰撞。

公司成立时间很短,目前暂时不会训练自研底座;未来几个月会基于第三方开源推理模型,通过强化学习等方式产出「认知模型」。用户自定义更换底层模型的权限,未来会开放。

新智元|我们测试中看到 UI 呈现似乎是线性串行(A 做完一段、B 接手、C 接手……),这只是展示上的妥协,还是后端逻辑本质仍串行?投票过程为何不展示更细?

李笛|线性更多是前端呈现策略,尤其是输出量大的「研究团」会按顺序展示以便阅读;后端实际发生了更多并行协作。

系统会在不直接打扰用户的情况下进行大量内部交互,例如先「仿真」一个用户或潜在读者,再在内部交换意见数百次,以提升内容适配与质量。

投票与讨论过程可追溯,但完全展开会造成信息过载;我们在权衡「可解释性」与「可阅读性」,因此前端会有意压缩展示信息。

新智元|产品形态上目前有「姐妹团」「研究团」「奇迹团」等,为什么没有「兄弟团」?不同团有什么区别?是否开放用户自定义?

李笛|团会开放用户自定义,且成员会随迭代动态调整。官方团也会不断补充完善。我们认为世界应当多样化,因此团的类型会更丰富(包括兄弟团等)。

三个团都能回答任何问题,但侧重点不同:姐妹团更偏向个人生活理解;研究团对标 Deep Research,更偏向深入分析;奇迹团更偏向学生与早期创业者问题拆解。

我们基本按周更新(每周三发布新团 / 新角色 / 新能力)。近期还会推出更专业的写作团,以及「千人以上的群体仿真团」,用于在仿真环境中预演公关稿、政策、产品投放等「覆水难收」的决策,遍历不同可能后果并给出风险点与应对。

新智元|关于 Grok Ani:它算不算您构想中的「小冰 / Nextie 的完全体」?以及擦边争议与 B 端品牌安全如何平衡?

李笛|更接近我设想的方向:未来是一个庞大的 Agent 网络,节点与人持续连接,交换知识、服务、内容,并共同建立可迁移、可流转的记忆。

早期用「情感」切入是为了建立关系;之后做 AIGC 是为了让互动不止于语言;大模型时代强调推理与认知,是为了让输出的逻辑与结论可用、可信。「擦边服务」不等同于「情感关系」。

关于 To B / To C,我更倾向认为未来界限会显著模糊:AI 的高并发能力会改变传统分工方式,组织会更小型、更弹性;同时「有趣与轻松」本身也是生产力,并不必然损害严肃场景,只要交付内容质量足够好。

新智元|从「小冰时期」到现在,团队吃过哪些亏?Nextie 想规避哪些「坑」?

李笛|主要反思两点:一是过去过度谨慎,过度担心风险导致能力「降智」、对话质量被削弱;二是在一些关键方向上不够坚决(例如推理 / 认知相关工作曾受限而停滞)。大公司包袱更重,容易被既有经验束缚;重新创业的意义之一,是把「看到的未来」更果断地做出来。

新智元|最后,请您用一句话概括 Nextie 的终极愿景:超级工具,还是硅基伴侣,或别的?

李笛|我们想做的是面向未来的「平台层基础设施」:让智能体「思考得更好、协同得更好」。

表面上我们会用若干第一方应用 / 团来承载体验与数据回环,但本质是在做一层类似「Agent OS / 平台层」的能力:底层模型能力来自大模型公司;智能体工具与工作流由应用方定义;而智能体的思考与协同机制,应当基于我们这一层。

你可以把平台上的每个「团」类比成上个时代的一个 App,而我们更像运行这些 App 的系统与平台层。