英伟达开源新模型Nemotron 3 Super,部分性能超越阿里Qwen!芯片+模型+平台全生态进军

昨天英伟达官网直接扔了个重磅:Nemotron 3 Super正式发布

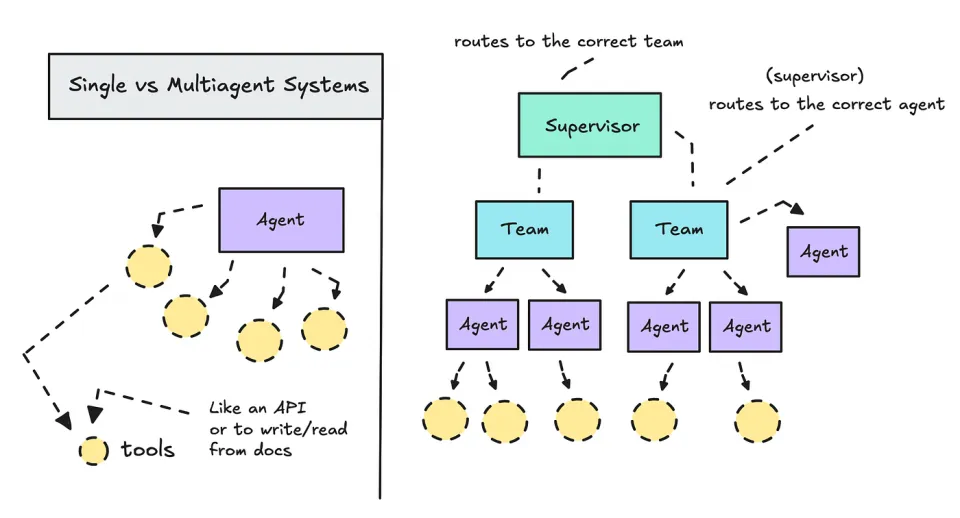

这家伙不是随便堆参数的模型,而是专为多代理协作量身定做的开放权重大杀器。

它共有1200亿参数,120亿激活参数,100万token上下文,推理提升3倍,吞吐量暴涨5倍

想想看,就在去年12月他们才放出Nemotron 3 Nano版,大家还在感慨“英伟达这是要卷死人”,结果仨月不到,Super版就来了,明显冲着企业级大规模落地去的。

黄老板这节奏,简直就是在喊:显卡我已经垄断了,现在模型我也来玩,顺便把全栈生态锁死

回想一下:2025年12月,英伟达先放出了Nemotron 3家族的Nano版(30B总参、3B激活),当时就惊艳了一波,说是要给代理AI铺路。

结果不到三个月,Super版就来了,明显是冲着企业级本地部署去的。

英伟达这节奏,简直像在说:芯片我已经霸榜了,现在连模型也要一起玩儿,转身就要从硬件厂商变成全栈AI平台

这次最炸的有2个地方!

NVFP4从头训起 + Blackwell深度优化!

预训练就用英伟达自家的4-bit浮点,推理在B200上比H100的FP8快4倍,精度还不崩。

为啥要用FP4呢?

FP8 和 FP4 就像视频清晰度被压缩:FP8 压得没那么狠,FP4 压得更狠一点。

位数越少,数据就越小,所以用 FP4 的好处是显存占得更少、带宽更低、速度更快、成本更便宜,同一张 GPU 可以跑更多数据。

如果模型一开始就用 FP4 训练,它会慢慢“习惯”这种低精度环境,推理的时候也不用再做量化压缩,效率会更高。

这是降低成本首选啊!也是未来的趋势!

但问题是 4 位精度太低了,训练很容易出问题,技术难度很高,而且现在基本只有英伟达新一代 GPU Blackwell对 FP4 优化最好,一用就等于把模型绑在英伟达的 GPU 上了!

混合Mamba-Transformer + Latent MoE

这可不是老派纯 Transformer 或是只靠 Mamba 的单一模型,而是把两者交替叠加使用

让 Mamba 专门处理长上下文还格外省算力,让 Transformer 牢牢把控精准回忆与细节输出,再搭配潜空间 MoE 设计,明明总参数有 120B,每次却只激活 12B 左右

对比传统纯 Transformer 模型,它处理长内容不卡顿、内存和算力消耗大减,官方数据更是比上代吞吐高 5 倍,对比纯 Mamba 模型,它不会丢失关键细节、回答更稳定准确,这样既能拥有大模型的能力又能兼顾小模型的运行成本

原生1M上下文窗口

上下文长的好处我就不多说了,在智能体里很有用,今年开源模型没有1M上下文都不好意思出来打招呼。

参数性能怎么样?

总参数120B,激活参数只有12.7B左右(官方数据略有浮动)。

推理速度实测能跑到450 tokens/s左右,在同级别开放模型里直接封神。官方直接放话:在8k输入/16k输出的场景下,比GPT-OSS-120B快2.2倍,比Qwen3.5-122B快7.5倍!

上下文真支持1M,PinchBench代理性能得分85.6%,目前开放模型里最强。

硬件门槛其实没那么高:因为MoE+NVFP4,单张H200就能跑多代理协作,真正发挥极致得用Blackwell B200集群。

跟Qwen比,优势劣势一目了然

Qwen(尤其是Qwen3.5系列)一直是开放模型里的王者,生态好用!700多万下载、18万衍生模型,多语言能力强,中文场景几乎无敌,价格也亲民。很多开发者直接拿Qwen当底座改。

但Nemotron 3 Super一出来,国外很多厂商可能会选择NV的模型了!

- 速度:7.5倍吞吐优势,代理场景下Qwen容易卡。

- 上下文:1M vs Qwen的26万token,长任务完全不是一个级别。

英伟达的野心

NVDA市值依然稳坐全球第一(4.5万亿美元左右),数据中心业务狂飙,GTC大会马上就要开,Jensen黄仁勋估计又要秀新花样。

市场给的信号很明确:大家不光买卡,还开始买“卡+模型+平台”整套方案。英伟达现在一边卖Blackwell,一边自己造开放模型,明摆着要锁死生态。

从这次操作看,英伟达明显在走“全栈闭环”路线,未来大概率会继续放Ultra版(500B级别),再推一堆行业Cookbook,甚至可能搞个“代理市场”让企业直接买现成代理流程。

对Qwen生态的冲击不小。Qwen一直靠“开放+便宜+中文强”吃全球开发者,尤其是亚太和中小企业。

现在英伟达扔出一个“美国版高效开放模型”,企业客户尤其是用NV卡的,很可能两边都试,Qwen在西方市场的份额可能被蚕食。

- 速度:7.5倍吞吐优势,代理场景下Qwen容易卡。

- 上下文:1M vs Qwen的26万token,长任务完全不是一个级别。

阿里云那边得赶紧加速推更好用的产品,不然生态优势会被慢慢稀释。目前顶尖模型上已经掉队了,开源领域在被超越,那阿里未来有点危险了。

模型地址:

https://huggingface.co/collections/nvidia/nvidia-nemotron-v3