刚刚,奥特曼光速滑跪背刺Anthropic,OpenAI高调签下军方大单

机器之心编辑部

就在奥特曼公开支持 Anthropic、声称反对五角大楼施压后不到 12 小时,剧情发生了戏剧性逆转。

本周,奥特曼在致 OpenAI 员工的备忘录中表示:「我们一直认为,人工智能不应用于大规模监控或自主致命武器,在涉及高风险的自动化决策中,人类应该始终参与其中。这些是我们的主要底线。」

他还在 CNBC 节目中重申:「我个人认为五角大楼不应以《国防生产法》威胁这些公司。尽管我和 Anthropic 公司有很多分歧,但我总体上还是信任他们这家公司,而且我认为他们确实很重视安全。」

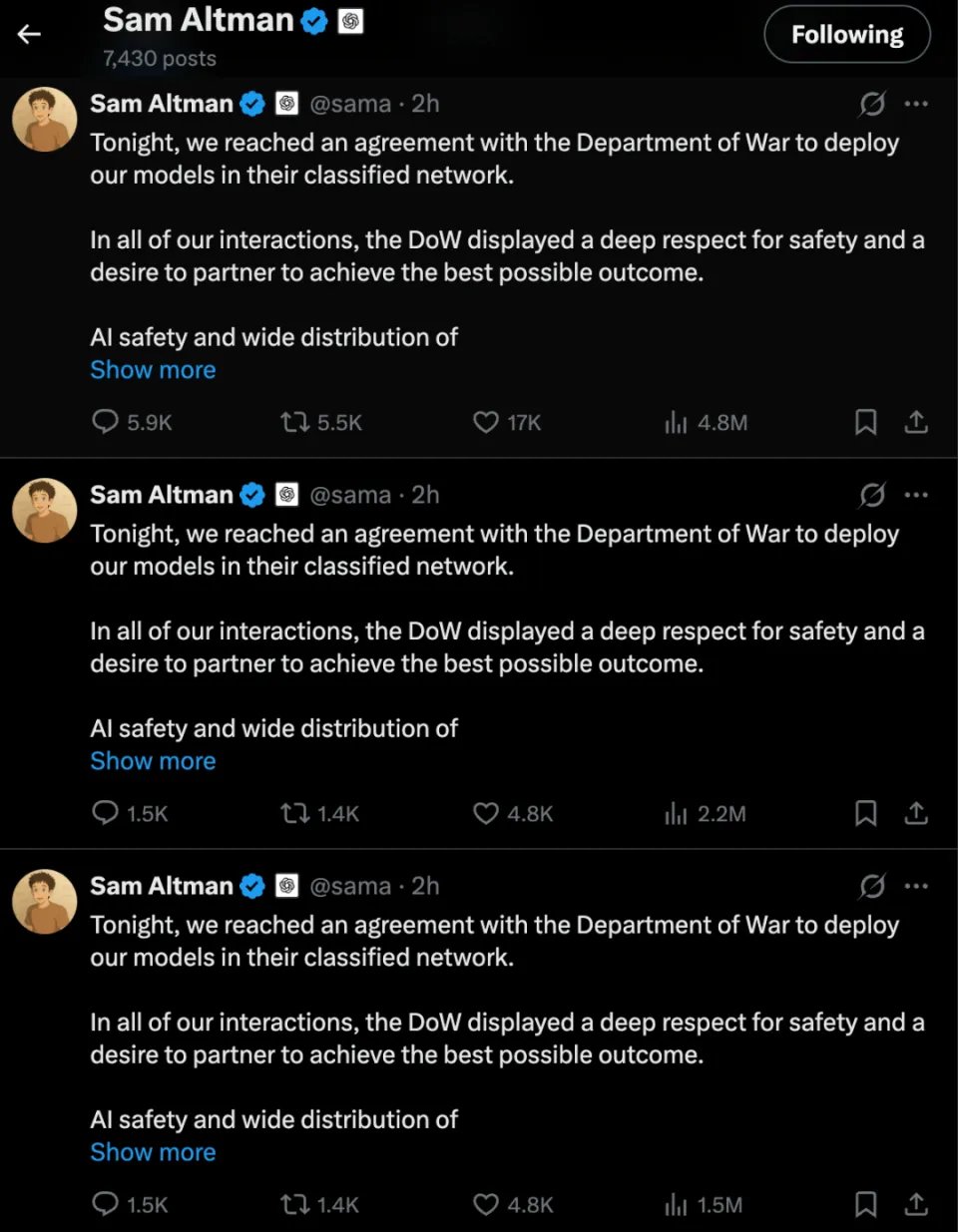

可刚刚,奥特曼在 X 上连发三条相同的帖子,宣布 OpenAI 已与美国五角大楼达成协议,将模型部署到他们的机密网络中。

奥特曼:我们谈妥了「安全条款」

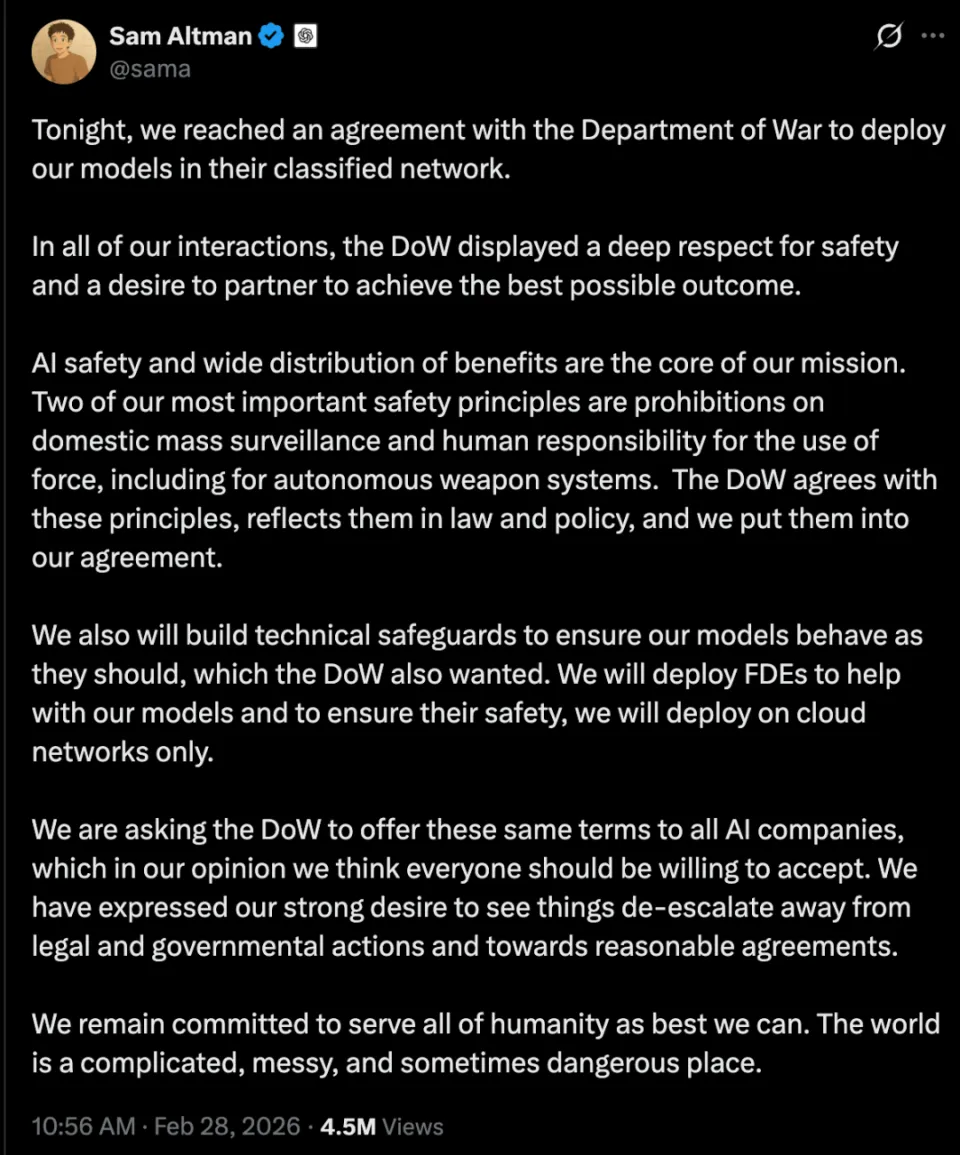

在帖子中,奥特曼是这么说的:

「在所有互动中,五角大楼都展现出对安全的深切尊重,以及与合作伙伴共同达成最佳结果的强烈意愿。

AI 安全和广泛惠益是我们使命的核心。我们最重要的两条安全原则是:禁止国内大规模监控,以及在包括自主武器系统在内的使用武力时,必须由人类承担责任。

五角大楼同意这些原则,并在法律和政策中有所体现,我们已将它们纳入本次协议。

我们还将构建技术防护措施,以确保模型按预期运行,这一点也得到了五角大楼的支持。为保障安全,我们将部署 FDEs 来辅助模型,且仅在云网络上进行部署。我们正在请求五角大楼向所有 AI 公司提供相同的条款,我们认为所有公司都应该愿意接受。

我们已明确表达强烈愿望,希望事态能从法律和政府行动中降级,转向通过合理协议解决。我们始终致力于尽最大努力服务全人类。这个世界复杂、混乱,有时还很危险。」

消息一出,网友炸了锅。

有人讽刺:所以 OpenAI 就这么在差不多 12 小时内,从「我们也有红线」快速转变成「我们的模型已经部署在物价大楼的机密网络上了」?…… 原则固然重要,但最终还是要等到合同敲定才行。话说回来,真到了 AI 辅助的战争迷雾中,谁来真正强制执行「人类对武力负责」这条?

也有网友质疑,要么是五角大楼对 OpenAI 和 Anthropic 采用了不同的标准,要么就是奥特曼在这条推文中故意误导大家。鉴于他过往的历史记录,我更倾向于后者。

还有网友追问,「如果这些条款本质上和 Anthropic 之前提出的差不多,那现在为什么就变得可以接受了呢?我真的很想搞清楚其中的区别到底在哪里。」

Anthropic 因「冒犯」领导层致谈判破裂

据《财富》杂志看到的会议纪要和一位与会消息人士透露,奥特曼在周五下午的全员大会上告诉员工,OpenAI 正与美国五角大楼就使用该公司的 AI 模型和工具达成潜在协议。 不过该合同当时尚未签署。

奥特曼表示,政府愿意让 OpenAI 构建自己的「安全堆栈」,即位于强大的 AI 模型和现实世界应用之间的技术、政策和人为控制的分层系统。如果模型拒绝执行某项任务,那么政府不会强迫 OpenAI 执行该任务。

OpenAI 将保留对技术保障措施实施方式、模型部署方式和部署地点的控制权,并将部署范围限制在云环境而非「边缘系统」(在军事领域,「边缘系统」可能包括飞机和无人机)。

作为一项重大让步,奥特曼告诉员工,政府表示愿意将 OpenAI 提出的「红线」纳入合同,例如不得使用人工智能驱动自主武器、进行国内大规模监控,以及不得替代人类参与关键决策。

据消息人士透露,OpenAI 国家安全政策负责人萨沙・贝克(Sasha Baker)和 OpenAI 政府部门国家安全负责人卡特里娜・穆里根(Katrina Mulligan)也在 OpenAI 全体员工大会上发表了讲话。

其中一位官员表示,Anthropic 与美国政府的关系破裂,是因为 Anthropic 联合创始人兼首席执行官达里奥・阿莫迪(Dario Amodei)冒犯了美国五角大楼领导层,包括发表了一些令五角大楼「不满」的博客文章。

同样的条款,两种结果

可见,此次事件最大的争议点在于:Anthropic 因为坚持「底线」拒绝与美国军方妥协,因而受到了惩罚,而 OpenAI 是否全盘接受了军方此前对 Anthropic 的强硬要求?

看起来并不是接受或不接受条款的问题。

我们此前看到的是,美军对 Anthropic 的态度极其强硬,要求其放弃一系列底线,允许其在「所有合法用途」下无条件、无限制地使用 AI。重点在于两点:严禁将其技术用于国内大规模监控,以及人类必须对武力使用负责。Anthropic 拒绝后,直接遭到了特朗普的全面封杀,并被国防部定性为「国家安全供应链风险」。

而在奥特曼高调宣布与五角大楼达成的协议中,军方在面对 OpenAI 时看起来「双标」了,接受了 OpenAI 提出的上述两条安全底线。

Altman 在声明中明确指出:「五角大楼同意了这些原则(禁止国内监控和自主武器),将其反映在法律和政策中,并且我们把它们写进了我们的协议里。」

在 OpenAI 宣布达成协议后,有人解读认为,为避免任何误解,OpenAI 与五角大楼的合同以「所有合法用途」为基石 —— 这正是五角大楼一直以来坚持的,也是 xAI 所同意的。但正如奥特曼所解释的,该合同引用了某些现有的法律依据,并包含了一些双方共同认可的安全机制。这再次表明,Anthropic 曾被提出过类似的妥协方案,但遭到了拒绝。

即使实质性问题相同,以下两种做法之间也存在巨大差异,OpenAI 同意通过援引特定法律和政策来记录具体的安全问题,而不是把审慎的约束留给科技公司的 CEO。

我们还不清楚 OpenAI 达成的协议与 Anthropic 的预期有何不同,但海格赛斯已经在 X 上转发了奥特曼的声明。

参考内容:

https://x.com/sama/status/2027578652477821175

https://www.cnn.com/2026/02/27/tech/openai-pentagon-deal-ai-systems

https://fortune.com/2026/02/27/openai-in-talks-with-pentagon-after-anthropic-blowup/